Was sind die besonderen Herausforderungen im Bereich Food & Beverage für die Bildverarbeitung?

Björn Milsch: Gerade in der Food-&-Beverage-Industrie herrschen teilweise sehr extreme Umgebungsbedingungen – zum Beispiel starke Kälte und Hitze. Daher müssen die Kameras und Bildverarbeitungssysteme, die eingesetzt werden, extrem robust sein. Der andere Punkt ist: Die Aufgabenbereiche sind extrem vielfältig. Das heißt, man sollte schon ein Bildverarbeitungssystem haben, das viele verschiedene Prüfalgorithmen bietet, um alle Aufgaben abdecken zu können.

Welche Aufgaben sind das?

Milsch: Das fängt an bei der Vermessung und Klassifizierung im Wareneingang und geht dann über die Aussortierung von Fremdkörpern weiter in die Prozesskette. Bis hin zu Anwendungen, in denen Backwaren in 3D vermessen werden.

Markus Hüttel: Es gibt einen entscheidenden Unterschied zur industriellen Bildverarbeitung. Dort geht es in der Regel um Produkte, die von Maschinen mit hoher Wiederholgenauigkeit hergestellt werden. Das heißt: Die Aufgabenstellung, wenn es um das Prüfen oder Messen geht, ist ziemlich klar beschrieben. Das ist im Bereich natürlicher Produkte anders. Hier gibt es keine exakten Vorgaben. Äpfel beispielsweise variieren in ihrem Aussehen. Dadurch sind die Aufgabenstellungen für den Bildverarbeiter komplexer und komplizierter. Häufig geht es auch gar nicht um klassische Qualitätsmerkmale, sondern um die Ästhetik – also ob die Kartoffel jetzt rund oder länglich ist. Und diese ästhetischen Qualitätsmerkmale zu beschreiben, ist relativ schwierig.

Michael Beising: Eigentlich produziert man im Food-&-Beverage-Bereich keine gleichen Teile, sondern nur ähnliche. Und dann muss man abwägen, ob die Ähnlichkeit eines Teils noch in Ordnung ist. Das ist das, was man in der klassischen Bildverarbeitung eigentlich eher nicht haben möchte.

Hüttel: Bei Produkten aus dem Lebensmittelbereich interessiert auch die chemische Zusammensetzung. Also zum Beispiel die Frage: Ist das Produkt noch in dem Zustand, dass es verkauft werden kann? Und dabei spielt dann die multispektrale beziehungsweise hyperspektrale Bildverarbeitung eine zunehmend wichtige Rolle.

Hyperspektral-Bildverarbeitung ist zur Zeit eines der großen Trendthemen. Wie verbreitet ist denn der Einsatz der Technologie überhaupt?

Beising: Die Technologie wird eingesetzt. Aber das Problem bei der Hyperspektraltechnik ist, dass es zu wenige Hersteller von Sensoren gibt. Jeder Kamerahersteller setzt praktisch die gleichen Sensoren ein. Und deren Preis ist relativ hoch. So können die Kameras insgesamt nicht günstiger werden.

Hüttel: Die Technologie ist noch relativ neu und recht teuer.

Beising: Wir brauchen mehr Wettbewerb, damit die Preise für Hyperspektralkameras runter gehen. Dann hätte die Bildverarbeitung Möglichkeiten ohne Ende.

Hüttel: Die Hersteller von Hyperspektralkameras gibt es vielleicht seit 15 oder 20 Jahren. Zunächst hatte man zu wenige Anwendungsfälle. Jetzt zeigt sich aber, dass die chemische Charakterisierung von Objekten zunehmend interessanter wird.

Das heißt, es gibt also zunehmend mehr Anwendungsmöglichkeiten?

Hüttel: Es gibt tatsächlich relativ viele Anwendungen – speziell im Bereich, wenn Objekte sortiert werden sollen. Wenn zum Beispiel eine Packung Linsen danach untersucht wird, ob in ihr Steine enthalten sind.

Milsch: Da muss ich einhaken. Um Steine von Obst oder Gemüse zu trennen, brauche ich keine Hyperspektralkamera. Dafür reicht eine Infrarotkamera oder eine Prismakamera mit zwei Sensoren. Mit dieser kann man sowohl die Qualitäten farbanalysieren als auch die Fremdkörper detektieren.

Beising: Klar, es muss nicht immer Hyperspektral sein. Aber wenn ich mit Hyperspektral arbeite, muss ich mir nicht überlegen, ob das Merkmal, um das es geht, noch in mein Spektrum fällt. Dann habe ich eine Technologie, die alles kann.

Milsch: Aber man muss es natürlich auch wirtschaftlich sehen. Häufig sagen Unternehmen: „Wir brauchen eine Hyperspektralkamera, um dieses oder jenes zu detektieren.“ Aber häufig benötigen sie für ihre Anwendung nur ein paar Wellenlängen. Wenn ich dem Kunden dann eine Kamera anbiete, mit der er zwei, drei oder vier Wellenlängen ermitteln kann, und die nur 20 % oder 25 % einer Hyperspektralkamera kostet, dann wird er sich für diese entscheiden.

Beising: Meistens weiß der Kunde gar nicht, was man mit der jeweiligen Technologie alles machen kann. Und wenn er sieht, was möglich ist, möchte er noch mehr Merkmale prüfen.

Milsch: Deswegen ist es wirklich essenziell, am Anfang die Anforderungen zu definieren.

Erhöht sich der Aufwand durch den Einsatz neuer Technologien wie der Hyperspektralbildverarbeitung. Sind vom Anwender neue Kompetenzen gefordert?

Beising: Man musste sich auch früher schon viele Gedanken machen, wenn man Bildverarbeitung eingesetzt hat. Bei der Hyperspektral-Technik kommen aber noch mehr Dimensionen hinzu. Der Nutzer ist mit Dingen konfrontiert, die er zunächst gar nicht verstehen kann. Ein Mensch hat ja kein Gefühl für mehrere Spektren. Da benötigt man einen Mitarbeiter, der sich zumindest eine Zeit lang in das Thema einarbeitet. Das ist schon sehr anspruchsvoll.

Hüttel: In der Bildverarbeitung haben wir es ja mit mehreren Disziplinen zu tun: Physik, Optik, Elektronik, Softwareherstellung, Algorithmen, Computertechnik. Bei der Multispektralen- oder Hyperspektral-Technik bedarf es nun auch chemischer Kenntnisse. Also zum Beispiel: Wie verhalten sich Moleküle bei Lichteinfall? Letztendlich geht es um die chemische Materialcharakteristik.

Auch die Fülle an Daten, die durch moderne Bildverarbeitung generiert wird, macht die Anwendungen komplexer. Kann Machine Learning dabei helfen, dieser Komplexität Herr zu werden?

Hüttel: Die Menge der Daten als solche ist es eigentlich nicht einmal. Maschine Learning ergibt dann Sinn, wenn Ursachen-Wirkzusammenhänge nicht mehr analytisch oder nur ganz schwer beschrieben werden können. Wenn ich zum Beispiel den Wirkzusammenhang von einem Spektrum und dem Alter einer Banane betrachte und dies nicht mehr analytisch abbilden kann. Dann verwende ich maschinelles Lernen. Das System erzeugt dabei ein Modell, das am Ende die Eingangsdaten – also die Fragestellung – und dazu die Ausgangsdaten abbildet.

In der Lebensmittelbranche gibt es ja häufig solche komplexen Zusammenhänge.

Hüttel: Ja – zum Beispiel die Beurteilung, ob Äpfel schön oder nicht schön aussehen.

Wie geht man dabei genau vor?

Hüttel: Man nimmt eine Menge von Äpfeln und sortiert diese in solche, die schön aussehen, und jene, die nicht schön aussehen. Dann nimmt man von jedem Apfel ein oder mehrere Bilder aus unterschiedlichen Perspektiven auf und merkt sich zu jedem Bild das Attribut „schön“ beziehungsweise „nicht schön“. Mit diesen Bildern wird dann von einem Computer mit Hilfe

eines Lernalgorithmus ein künstliches Neuronales Netz so modifiziert, dass dieses am Ende des Trainings zum Bild eines schönen Apfels das Attribut „schön“ und zum Bild eines nicht schönen Apfels das Attribut „nicht schön“ ausgibt. Dabei ist bemerkenswert, dass dies auch für Bilder von Äpfeln funktioniert, die dem Computer zuvor noch nie vorgelegt wurden.

Aber Machine-Learning-Systeme müssen mit möglichst vielen Daten gefüttert werden, um verlässliche Ergebnisse zu erhalten. Reicht die Menge an Bildern, die in der Qualitätskontrolle zur Verfügung stehen, dafür aus?

Beising: Unternehmen, die zum Beispiel Äpfel produzieren, müssen natürlich zunächst einen Mitarbeiter zwei Wochen abstellen, der die Äpfel qualifiziert. Aber anschließend haben sie eine Datenbank, in der die Äpfel mit ihren Merkmalen enthalten sind. Meistens fängt man ja auch nicht mit einem leeren Netz an, sondern mit einem vorqualifiziertem Netz. Und diesem fügt man dann zusätzliche Daten hinzu. Dann konvergiert es auch schneller. Das hängt auch von der Anwendung ab. Wenn die Merkmale zur Unterscheidung sehr eindeutig sind, werden weniger Bilder benötigt.

Milsch: Grundsätzlich gilt das Prinzip: Je trennschärfer ich gut und schlecht von-

einander unterscheiden kann, desto weniger Bilder brauche ich. Je näher die Merkmale beieinander liegen, desto mehr Bilder muss ich teachen.

Hüttel: Ein großer Vorteil dieser neuronalen Netze oder der lernenden Systeme ist, dass diese nicht jedes Exemplar, das sie richtig einsortieren sollen, gesehen haben müssen. Die Systeme lernen an einer Menge von Beispielen und können dann anhand dieser Beispiele interpolieren beziehungsweise abstrahieren. Es ist sogar eine relativ wichtige Voraussetzung, dass man diese Netze so trainiert und sie die Beispiele nicht nur auswendig lernen. Denn dann reagieren sie nur noch auf die auswendig gelernten Objekte und erkennen den Rest nicht mehr verlässlich.

Ist das Thema schon in der Praxis angekommen?

Milsch: Wenn es um Deep Learning geht, muss man sagen: Im Moment sind diese Technologien noch sehr stark ein Forschungsthema. Meines Wissens lässt der Übergang in die Industrie noch ein bisschen auf sich warten. Er wird aber zweifellos kommen.

Beising: Der Knackpunkt ist häufig, die Auswertung in Echtzeit – also im Produktionstakt – wirtschaftlich umzusetzen. Man kann zwar heute für 100.000 Euro oder mehr einen schnellen Rechner kaufen, aber das ist für die meisten Betriebe nicht tragbar. Einige der großen Hersteller haben jetzt aber Chips auf den Markt gebracht, mit denen sich auch kleinere Netze in Echtzeit rechnen lassen. Allerdings fallen mir jetzt für solche kleinen Netze spontan keine Anwendungen im Lebensmittelbereich ein.

Gibt es weitere Technologen, die in der Food&Beverage-Branche von Bedeutung sind?

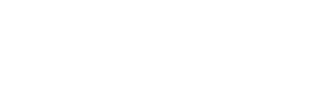

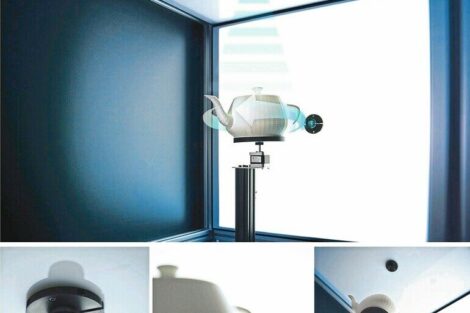

Milsch: Speziell in der Getränke-Industrie spielen auch Polarisationskameras eine wichtige Rolle. So weit ich weiß, werden auf der Vision mindestens drei Firmen – unter anderem auch meine – neue Polarisationskameras präsentieren. Diese eignen sich optimal, um zum Beispiel in der Getränkeabfüllung Glasspannung oder Einschlüsse im Glas durch Luftblasen zu erkennen.

Beising: Wir wissen, dass sich die Polarisationstechnik für Glas eignet. Aber wahrscheinlich lässt sie sich auch für andere Materialien nutzen, die ähnliche Eigenschaften haben. Daneben wäre es auch schön für die Nahrungsmittelindustrie, wenn es gelingen würde, Terahertz-Sensoren günstiger anzubieten. Dann könnte man zum Beispiel auch mal unter die Verpackung eines Schokoriegels schauen. Das ist zwar teilweise auch mit Thermografie möglich. Aber mit einem Terahertz-Sensor kann man das noch ein Tick besser machen.

Hüttel: Mit Terahertz-Technologie lassen sich insbesondere Körper, die Wasser enthalten, detektieren und charakterisieren. Und Lebensmittel bestehen ja auch zu einem großen Teil aus Wasser. Aber die Technologie ist noch sehr teuer.

Beising: Das Problem ist: Man braucht erst mal eine Kamera, um dann herauszufinden, was man mit ihr alles machen kann. Erst wenn man es ausprobiert, wird ersichtlich, für welche Anwendungen sich die jeweilige Technik eignet. Das ist grundsätzlich so in der Bildverarbeitung. ■

Die Diskussionsteilnehmer

- Markus Hüttel, Abteilungsleiter Bild- und Signalverarbeitung, Fraunhofer IPA

- Björn Milsch, Regional Sales Manager, JAI

- Michael Beising, Geschäftsführer, EVT

Vision mit Rekordergebnis

11.100 Fachbesucher zählte die Vision 2018 – und damit 14 % mehr im Vergleich zur Vorveranstaltung. Dies ist ein Besucherrekord. Der Anteil an Besuchern, die aus dem Ausland zur Weltleitmesse der Bildverarbeitung nach Stuttgart anreisten, stieg auf einen Rekordwert von 47 %. „Die Vision ist die Weltleitmesse der Branche und war drei Tage der Puls für die Bildverarbeitung. Insbesondere die Qualität der Gespräche und das große Besucherinteresse an konkreten Lösungen sind beeindruckend“, sagt Dr. Klaus-Henning Noffz, CEO von Silicon Software und Vorsitzender des Vorstands der VDMA-Fachabteilung Industrielle Bildverarbeitung. „Die Bildverarbeitungstechnologie hat sich längst als ‚das Auge‘ und Datenlieferant von Industrie 4.0 sowie in unzähligen nichtindustriellen Anwendungsbereichen etabliert. Die Innovationskraft und die Dynamik der Branche sind vielversprechend, sodass wir gespannt sind, was die Vision 2020 bereithält“, so Noffz. ■

Video

Video

Video